لقد كان السباق نحو نماذج ذكاء اصطناعي أكبر من أي وقت مضى سمة مميزة للتطورات الأخيرة. ومع ذلك، تعمل Microsoft على إحداث تغييرات جذرية من خلال جهاز Phi-3 Mini، وهو نموذج يعمل بالذكاء الاصطناعي يتميز بقدرات رائعة على الرغم من حجمه الصغير.

تقليديا، كان النجاح في نماذج اللغة الكبيرة (LLMs) مرتبطا بعدد المعلمات - وهي في الأساس اللبنات الأساسية التي تحدد فهم النموذج للغة.

ومع أخذ تكاليف الحوسبة ومدى التوفر للجميع في الاعتبار، فإن Microsoft Phi-3 موجود هنا لتغيير هذا النهج "التقليدي".

يناسب Microsoft Phi-3 Mini العملاق في جيوبك

GPT-3.5، المرشح الأوفر حظًا حاليًا في سباق LLM، يضم 175 مليار معلمة مذهلة. يسمح هذا العدد الهائل لـ GPT-3.5 بمعالجة كميات هائلة من البيانات النصية، مما يمنحه فهمًا واسعًا ودقيقًا للغة. ومع ذلك، فإن هذا التعقيد يأتي أيضًا بتكلفة. يتطلب تشغيل نموذج يحتوي على مثل هذا العدد الكبير من المعلمات موارد حسابية كبيرة، مما يجعله مكلفًا ومتعطشًا للطاقة.

ومن ناحية أخرى، يتخذ نموذج ميكروسوفت المصغر نهجا مختلفا. ومن خلال استخدام مجموعة أصغر بكثير من المعلمات - 3.8 مليار فقط - يعمل جهاز Phi-3 Mini بمستوى من الكفاءة يتضاءل أمام نظيراته الأكبر حجمًا. هذا التخفيض في الحجم يترجم إلى العديد من المزايا.

كل هذا يجعل Microsoft Phi-3:

- أقل تكلفة بكثير للتشغيل

- قوة محتملة لتطبيقات الذكاء الاصطناعي على الجهاز

نظام تدريب Phi-3 Mini

جانب آخر مثير للاهتمام في Phi-3 Mini هو طريقة التدريب.

على عكس نظيراتها الأكبر حجمًا التي تم تدريبها على مجموعات بيانات ضخمة من النصوص والأكواد، تضمن تعليم Phi-3 Mini اختيارًا أكثر تنظيمًا. اختار الباحثون منهجًا مستوحى من كيفية تعلم الأطفال، وذلك باستخدام كتب الأطفال كأساس.

ويبدو أن هذا النهج قد حقق نتائج إيجابية، حيث أظهر Phi-3 Mini أداءً ينافس أداء GPT-3.5. عدة معايير.

المعيارية للنجاح

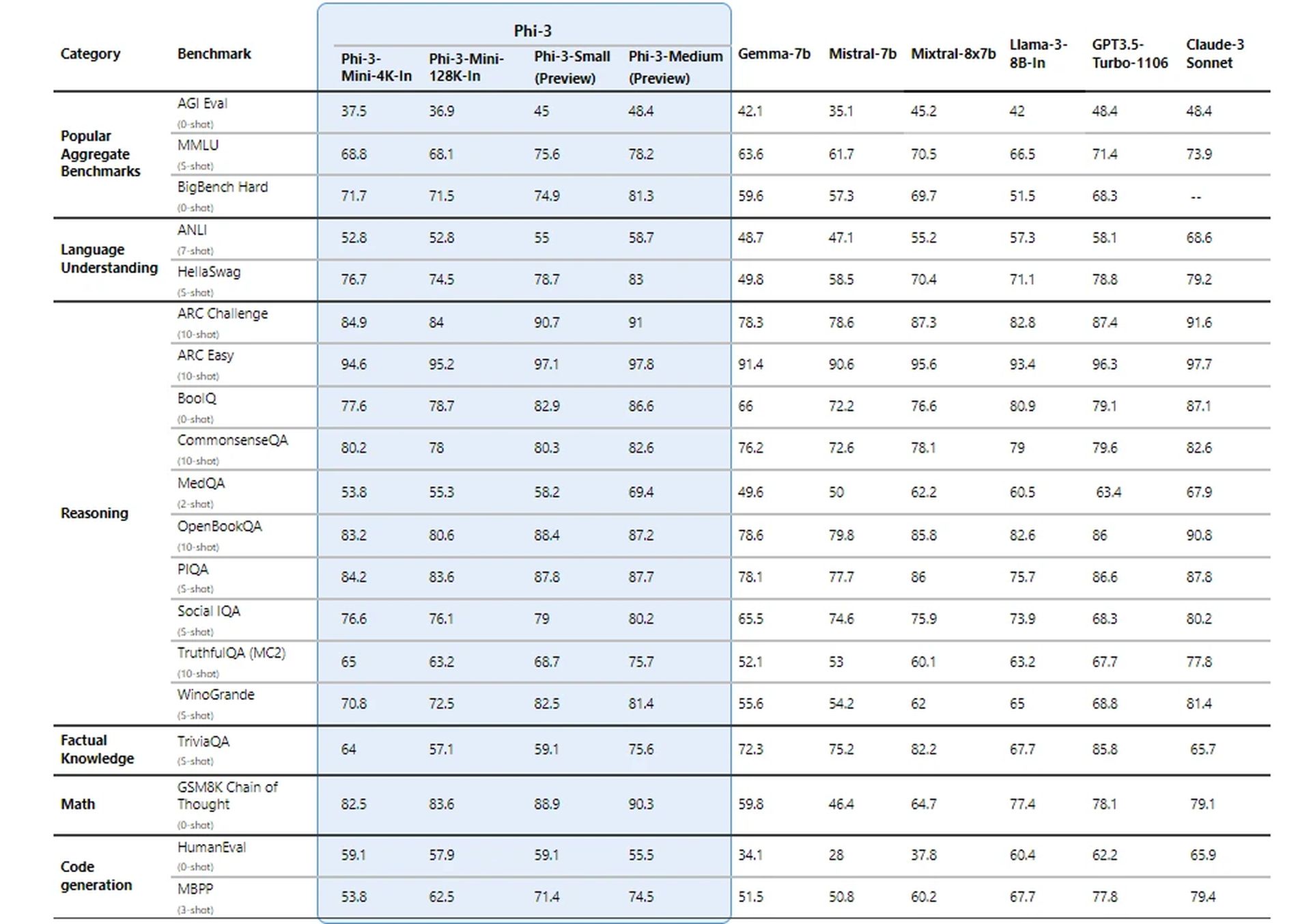

قام باحثو مايكروسوفت بوضع نموذجها الجديد من خلال خطواتها باستخدام معايير ثابتة لماجستير القانون. حقق النموذج درجات مبهرة في مقاييس مثل MMLU (مقياس لقدرة النموذج على فهم العلاقات المعقدة في اللغة) وMT-bench (اختبار لقدرات الترجمة الآلية).

وتشير هذه النتائج إلى أن Phi-3 Mini، على الرغم من حجمه، يمكنه منافسة الأسماء الكبيرة في لعبة LLM.

فكيف يحقق مثل هذه النتائج المبهرة؟

تكشف التفاصيل الفنية لجهاز Phi-3 Mini عن أسلوب رائع لتحقيق نتائج مبهرة مع حجم نموذج صغير بشكل ملحوظ. وفيما يلي تفصيل للجوانب الرئيسية:

بنية فك ترميز المحولات

يستخدم Phi-3 Mini بنية فك ترميز المحولات، وهو خيار تصميم شائع لنماذج اللغة الفعالة. تتفوق هذه البنية في معالجة البيانات المتسلسلة مثل النص، مما يسمح للنموذج بفهم العلاقات بين الكلمات في الجملة.

طول السياق

يعمل جهاز Phi-3 Mini القياسي بطول سياق يبلغ 4,000 رمزًا. يحدد هذا الحد الأقصى لعدد الرموز المميزة (الكلمات أو أجزاء الكلمات) التي يأخذها النموذج في الاعتبار عند إنشاء النص. يسمح طول السياق الأطول بفهم أعمق للمحادثة السابقة ولكنه يتطلب أيضًا المزيد من قوة المعالجة.

نسخة ذات سياق طويل (Phi-3-Mini-128K)

بالنسبة للمهام التي تتطلب سياقًا أوسع، يتوفر متغير يسمى Phi-3-Mini-128K. يعمل هذا الإصدار على توسيع طول السياق إلى 128,000 رمزًا ضخمًا، مما يمكنه من التعامل مع تسلسلات أكثر تعقيدًا من المعلومات.

التوافق مع الأدوات الموجودة

ولإفادة مجتمع المطورين، تشترك Phi-3 Mini في بنية وحجم مفردات مماثل (320,641) مع عائلة نماذج Llama-2. يتيح هذا التوافق للمطورين الاستفادة من الأدوات والمكتبات الموجودة المصممة لـ Llama-2 عند العمل مع Phi-3 Mini.

معلمات النموذج

هذا هو المكان الذي يتألق فيه Phi-3 Mini حقًا. مع 3.072 مليار معلمة فقط، فإنها تعمل أقل بكثير من الأرقام المذهلة التي شوهدت في النماذج الأكبر مثل GPT-3.5 (175 مليار معلمة).

يُترجم هذا الانخفاض الكبير في المعلمات إلى كفاءة استثنائية من حيث قوة المعالجة واستخدام الذاكرة.

يشرح سيف نايك من مايكروسوفت:

"هدفنا مع مساعد الطيار كريشي ميترا هو تحسين الكفاءة مع الحفاظ على دقة نموذج اللغة الكبير. نحن متحمسون للدخول في شراكة مع Microsoft لاستخدام إصدارات مضبوطة بدقة من Phi-3 لتحقيق أهدافنا - الكفاءة والدقة!"

– سيف نايك، رئيس قسم التكنولوجيا في ITCMAARS

منهجية التدريب

يستمد تدريب Phi-3 Mini الإلهام من منهج "الكتب المدرسية هي كل ما تحتاجه". تركز هذه الطريقة على بيانات التدريب عالية الجودة بدلاً من مجرد زيادة حجم النموذج. يتم تنظيم بيانات التدريب بعناية، مع التركيز على مصادر الويب ذات "المستوى التعليمي" المحدد والبيانات الاصطناعية التي تم إنشاؤها بواسطة LLMs أخرى.

تتيح هذه الإستراتيجية لـ Phi-3 Mini تحقيق نتائج مبهرة على الرغم من حجمه الصغير.

تصفية البيانات للتعلم الأمثل

على عكس الأساليب التقليدية التي تعطي الأولوية للموارد الحسابية أو التدريب المفرط، يركز Phi-3 Mini على "النظام الأمثل للبيانات" بالنسبة لحجمه. يتضمن ذلك تصفية بيانات الويب بدقة للتأكد من أنها تحتوي على المستوى المناسب من "المعرفة" وتعزز مهارات التفكير.

على سبيل المثال، قد يتم استبعاد البيانات الرياضية العامة لتحديد أولويات المعلومات التي تعمل على تحسين قدرة النموذج على التفكير.

الضبط الدقيق بعد التدريب

بعد عملية التدريب الأساسية، يخضع النموذج الجديد لتحسين إضافي من خلال الضبط الدقيق الخاضع للإشراف (SFT) وتحسين التفضيل المباشر (DPO). يعرض SFT النموذج للبيانات المنسقة عبر مجالات مختلفة، بما في ذلك مبادئ الرياضيات والتشفير والسلامة. يساعد DPO في توجيه النموذج بعيدًا عن السلوك غير المرغوب فيه من خلال تحديد المخرجات غير المرغوب فيها واستبعادها.

تعمل مرحلة ما بعد التدريب هذه على تحويل Phi-3 Mini من نموذج لغوي إلى مساعد ذكاء اصطناعي متعدد الاستخدامات وآمن.

أداء فعال على الجهاز

يُترجم الحجم الصغير لجهاز Phi-3 Mini إلى أداء استثنائي على الجهاز. ومن خلال تكميم النموذج إلى 4 بتات، فإنه يشغل 1.8 غيغابايت فقط من الذاكرة.

مباراة مصنوعة في الجنة

هل تتذكر محاولات مايكروسوفت الفاشلة للهواتف الذكية؟ ماذا عن صفقات التكامل الفاشلة مع Google Gemini في الأشهر الأخيرة؟ أو هل كنت تتابع أخبار شركة Apple التي تتحدث بصوت عالٍ عن دمج LLM على الجهاز مع iOS 18 خلال الأسابيع القليلة الماضية؟

هل قرع جرس?

إن التطبيقات المحتملة لـ Phi-3 Mini واسعة النطاق. إن كفاءته تجعله مثاليًا للتكامل مع الأجهزة المحمولة، مما قد يؤدي إلى تمكين ميزات مثل المساعدين الافتراضيين الأكثر ذكاءً والترجمة اللغوية في الوقت الفعلي. بالإضافة إلى ذلك، يمكن أن تفتح فعاليتها من حيث التكلفة الأبواب أمام اعتمادها على نطاق أوسع من قبل المطورين الذين يعملون في العديد من المشاريع التي تعمل بالذكاء الاصطناعي.

وهذا بالضبط ما كانت تبحث عنه شركة أبل. وبطبيعة الحال، هذا الادعاء ليس أكثر من مجرد تخمين في الوقت الحالي، ولكن لن يكون من الخطأ القول بأن هذه "مباراة صنعت في الجنة". الى جانب ذلك، في الورقة البحثية، مشروع مايكروسوفت الجديد تم تشغيله بالفعل على iPhone باستخدام شريحة A16 Bionic أصلاً.

يعتمد نجاح Phi-3 Mini على مجموعة من العوامل - بنية مناسبة تمامًا، والاستخدام الفعال لطول السياق، والتوافق مع الأدوات الحالية، والتركيز على بيانات التدريب عالية الجودة، وتقنيات التحسين. يمهد هذا النهج الفريد الطريق لنماذج الذكاء الاصطناعي القوية والفعالة التي يمكنها العمل بسلاسة على الأجهزة الشخصية.

رصيد الصورة المميز: فيستوك/فريبيك

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- أفلاطون هيلث. التكنولوجيا الحيوية وذكاء التجارب السريرية. الوصول هنا.

- المصدر https://dataconomy.com/2024/04/24/microsoft-phi-3/