Gambar oleh Editor

Kami telah melihat model bahasa besar (LLM) bermunculan setiap minggu, dengan semakin banyak chatbot yang dapat kami gunakan. Namun, sulit untuk mengetahui mana yang terbaik, kemajuan masing-masing, dan mana yang paling berguna.

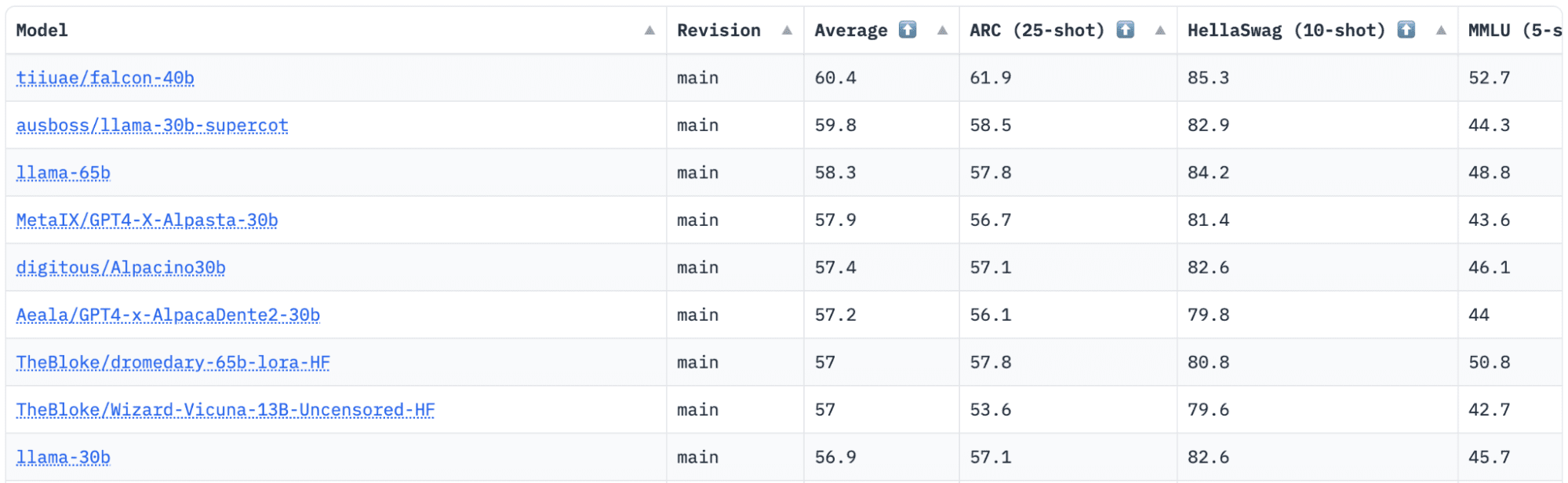

MemelukWajah memiliki Papan Peringkat LLM Terbuka yang melacak, mengevaluasi, dan memberi peringkat pada LLM saat dirilis. Mereka menggunakan kerangka unik yang digunakan untuk menguji model bahasa generatif pada tugas evaluasi yang berbeda.

Baru-baru ini, LLaMA (Large Language Model Meta AI) berada di puncak papan peringkat dan baru-baru ini dicopot oleh LLM baru yang telah dilatih sebelumnya – Falcon 40B.

Image by Papan Peringkat LLM HuggingFace Terbuka

Falcon LLM Didirikan dan dibangun oleh Institut Inovasi Teknologi (TII), sebuah perusahaan yang merupakan bagian dari Dewan Riset Teknologi Lanjutan Pemerintah Abu Dhabi. Pemerintah mengawasi penelitian teknologi di seluruh Uni Emirat Arab, di mana tim ilmuwan, peneliti, dan insinyur fokus pada penyampaian teknologi transformatif dan penemuan dalam sains.

Elang-40B adalah LLM dasar dengan parameter 40 miliar, melatih satu triliun token. Falcon 40B adalah model khusus dekoder autoregresif. Model khusus dekoder autoregresif berarti model tersebut dilatih untuk memprediksi token berikutnya dalam urutan berdasarkan token sebelumnya. Model GPT adalah contoh bagusnya.

Arsitektur Falcon telah terbukti secara signifikan mengungguli GPT-3 hanya dalam 75% anggaran komputasi pelatihan, serta hanya memerlukan ? dari komputasi pada waktu inferensi.

Kualitas data dalam skala besar merupakan fokus penting tim di Institut Inovasi Teknologi, seperti yang kita ketahui bahwa LLM sangat sensitif terhadap kualitas data pelatihan. Tim membangun saluran data yang berskala hingga puluhan ribu inti CPU untuk pemrosesan cepat dan mampu mengekstrak konten berkualitas tinggi dari web menggunakan pemfilteran dan deduplikasi ekstensif.

Mereka juga memiliki versi lain yang lebih kecil: Elang-7B yang memiliki parameter 7 miliar, dilatih pada 1,500 miliar token. Serta a Falcon-40B-Instruksikan, dan Falcon-7B-Instruksikan tersedia model, jika anda sedang mencari model chat siap pakai.

Apa yang bisa dilakukan Falcon 40B?

Mirip dengan LLM lainnya, Falcon 40B dapat:

- Hasilkan konten kreatif

- Memecahkan masalah yang rumit

- Operasi layanan pelanggan

- Asisten virtual

- Terjemahan Bahasa

- Analisis sentimen.

- Kurangi dan otomatisasi pekerjaan yang “berulang”.

- Membantu perusahaan-perusahaan Emirat menjadi lebih efisien

Bagaimana Falcon 40B dilatih?

Dilatih dengan 1 triliun token, diperlukan 384 GPU di AWS, selama dua bulan. Dilatih dengan 1,000 miliar token Web Sempurna, kumpulan data web berbahasa Inggris besar-besaran yang dibuat oleh TII.

Data prapelatihan terdiri dari kumpulan data publik dari web, menggunakan Perayapan Umum. Tim menjalani fase penyaringan menyeluruh untuk menghapus teks yang dihasilkan mesin, dan konten dewasa serta deduplikasi apa pun untuk menghasilkan kumpulan data pra-pelatihan yang berjumlah hampir lima triliun token telah dikumpulkan.

Dibangun di atas CommonCrawl, kumpulan data RefinedWeb telah menunjukkan model mencapai performa yang lebih baik dibandingkan model yang dilatih pada kumpulan data yang dikurasi. RefinedWeb juga ramah multimodal.

Setelah siap, Falcon divalidasi terhadap benchmark sumber terbuka seperti EAI Harness, HELM, dan BigBench.

Mereka memiliki Falcon LLM sumber terbuka kepada publik, menjadikan Falcon 40B dan 7B lebih mudah diakses oleh peneliti dan pengembang karena didasarkan pada rilis Lisensi Apache Versi 2.0.

LLM yang tadinya hanya untuk penelitian dan penggunaan komersial, kini telah menjadi sumber terbuka untuk memenuhi permintaan global akan akses inklusif terhadap AI. Kini AI sudah bebas royalti untuk pembatasan penggunaan komersial, karena UEA berkomitmen untuk mengubah tantangan dan batasan dalam AI dan bagaimana AI memainkan peran penting di masa depan.

Bertujuan untuk menumbuhkan ekosistem kolaborasi, inovasi, dan berbagi pengetahuan di dunia AI, Apache 2.0 memastikan keamanan dan keamanan perangkat lunak sumber terbuka.

Jika Anda ingin mencoba versi Falcon-40B yang lebih sederhana yang lebih cocok untuk instruksi umum bergaya chatbot, Anda ingin menggunakan Falcon-7B.

Jadi mari kita mulai…

Jika Anda belum melakukannya, instal paket berikut:

!pip install transformers

!pip install einops

!pip install accelerate

!pip install xformers

Setelah Anda menginstal paket-paket ini, Anda dapat melanjutkan menjalankan kode yang disediakan Instruksi Falcon 7-B:

from transformers import AutoTokenizer, AutoModelForCausalLM

import transformers

import torch model = "tiiuae/falcon-7b-instruct" tokenizer = AutoTokenizer.from_pretrained(model)

pipeline = transformers.pipeline( "text-generation", model=model, tokenizer=tokenizer, torch_dtype=torch.bfloat16, trust_remote_code=True, device_map="auto",

)

sequences = pipeline( "Girafatron is obsessed with giraffes, the most glorious animal on the face of this Earth. Giraftron believes all other animals are irrelevant when compared to the glorious majesty of the giraffe.nDaniel: Hello, Girafatron!nGirafatron:", max_length=200, do_sample=True, top_k=10, num_return_sequences=1, eos_token_id=tokenizer.eos_token_id,

)

for seq in sequences: print(f"Result: {seq['generated_text']}")

Berdiri sebagai model sumber terbuka terbaik yang ada, Falcon telah mengambil alih mahkota LLaMA, dan orang-orang kagum dengan arsitekturnya yang sangat optimal, sumber terbuka dengan lisensi unik, dan tersedia dalam dua ukuran: parameter 40B dan 7B.

Sudahkah Anda mencobanya? Jika sudah, beri tahu kami di komentar apa pendapat Anda.

Nisa Arya adalah Ilmuwan Data, Penulis Teknis Lepas, dan Manajer Komunitas di KDnuggets. Dia sangat tertarik untuk memberikan nasihat atau tutorial karir Ilmu Data dan pengetahuan berbasis teori seputar Ilmu Data. Dia juga ingin menjelajahi berbagai cara Kecerdasan Buatan bermanfaat bagi umur panjang kehidupan manusia. Seorang pembelajar yang tajam, berusaha memperluas pengetahuan teknologi dan keterampilan menulisnya, sambil membantu membimbing orang lain.

Lebih Lanjut Tentang Topik Ini

Falcon LLM: Raja Baru LLM Sumber Terbuka – KDnuggets

Diterbitkan Ulang Oleh Plato

Gambar oleh Editor

Kami telah melihat model bahasa besar (LLM) bermunculan setiap minggu, dengan semakin banyak chatbot yang dapat kami gunakan. Namun, sulit untuk mengetahui mana yang terbaik, kemajuan masing-masing, dan mana yang paling berguna.

MemelukWajah memiliki Papan Peringkat LLM Terbuka yang melacak, mengevaluasi, dan memberi peringkat pada LLM saat dirilis. Mereka menggunakan kerangka unik yang digunakan untuk menguji model bahasa generatif pada tugas evaluasi yang berbeda.

Baru-baru ini, LLaMA (Large Language Model Meta AI) berada di puncak papan peringkat dan baru-baru ini dicopot oleh LLM baru yang telah dilatih sebelumnya – Falcon 40B.

Image by Papan Peringkat LLM HuggingFace Terbuka

Falcon LLM Didirikan dan dibangun oleh Institut Inovasi Teknologi (TII), sebuah perusahaan yang merupakan bagian dari Dewan Riset Teknologi Lanjutan Pemerintah Abu Dhabi. Pemerintah mengawasi penelitian teknologi di seluruh Uni Emirat Arab, di mana tim ilmuwan, peneliti, dan insinyur fokus pada penyampaian teknologi transformatif dan penemuan dalam sains.

Elang-40B adalah LLM dasar dengan parameter 40 miliar, melatih satu triliun token. Falcon 40B adalah model khusus dekoder autoregresif. Model khusus dekoder autoregresif berarti model tersebut dilatih untuk memprediksi token berikutnya dalam urutan berdasarkan token sebelumnya. Model GPT adalah contoh bagusnya.

Arsitektur Falcon telah terbukti secara signifikan mengungguli GPT-3 hanya dalam 75% anggaran komputasi pelatihan, serta hanya memerlukan ? dari komputasi pada waktu inferensi.

Kualitas data dalam skala besar merupakan fokus penting tim di Institut Inovasi Teknologi, seperti yang kita ketahui bahwa LLM sangat sensitif terhadap kualitas data pelatihan. Tim membangun saluran data yang berskala hingga puluhan ribu inti CPU untuk pemrosesan cepat dan mampu mengekstrak konten berkualitas tinggi dari web menggunakan pemfilteran dan deduplikasi ekstensif.

Mereka juga memiliki versi lain yang lebih kecil: Elang-7B yang memiliki parameter 7 miliar, dilatih pada 1,500 miliar token. Serta a Falcon-40B-Instruksikan, dan Falcon-7B-Instruksikan tersedia model, jika anda sedang mencari model chat siap pakai.

Apa yang bisa dilakukan Falcon 40B?

Mirip dengan LLM lainnya, Falcon 40B dapat:

Bagaimana Falcon 40B dilatih?

Dilatih dengan 1 triliun token, diperlukan 384 GPU di AWS, selama dua bulan. Dilatih dengan 1,000 miliar token Web Sempurna, kumpulan data web berbahasa Inggris besar-besaran yang dibuat oleh TII.

Data prapelatihan terdiri dari kumpulan data publik dari web, menggunakan Perayapan Umum. Tim menjalani fase penyaringan menyeluruh untuk menghapus teks yang dihasilkan mesin, dan konten dewasa serta deduplikasi apa pun untuk menghasilkan kumpulan data pra-pelatihan yang berjumlah hampir lima triliun token telah dikumpulkan.

Dibangun di atas CommonCrawl, kumpulan data RefinedWeb telah menunjukkan model mencapai performa yang lebih baik dibandingkan model yang dilatih pada kumpulan data yang dikurasi. RefinedWeb juga ramah multimodal.

Setelah siap, Falcon divalidasi terhadap benchmark sumber terbuka seperti EAI Harness, HELM, dan BigBench.

Mereka memiliki Falcon LLM sumber terbuka kepada publik, menjadikan Falcon 40B dan 7B lebih mudah diakses oleh peneliti dan pengembang karena didasarkan pada rilis Lisensi Apache Versi 2.0.

LLM yang tadinya hanya untuk penelitian dan penggunaan komersial, kini telah menjadi sumber terbuka untuk memenuhi permintaan global akan akses inklusif terhadap AI. Kini AI sudah bebas royalti untuk pembatasan penggunaan komersial, karena UEA berkomitmen untuk mengubah tantangan dan batasan dalam AI dan bagaimana AI memainkan peran penting di masa depan.

Bertujuan untuk menumbuhkan ekosistem kolaborasi, inovasi, dan berbagi pengetahuan di dunia AI, Apache 2.0 memastikan keamanan dan keamanan perangkat lunak sumber terbuka.

Jika Anda ingin mencoba versi Falcon-40B yang lebih sederhana yang lebih cocok untuk instruksi umum bergaya chatbot, Anda ingin menggunakan Falcon-7B.

Jadi mari kita mulai…

Jika Anda belum melakukannya, instal paket berikut:

Setelah Anda menginstal paket-paket ini, Anda dapat melanjutkan menjalankan kode yang disediakan Instruksi Falcon 7-B:

Berdiri sebagai model sumber terbuka terbaik yang ada, Falcon telah mengambil alih mahkota LLaMA, dan orang-orang kagum dengan arsitekturnya yang sangat optimal, sumber terbuka dengan lisensi unik, dan tersedia dalam dua ukuran: parameter 40B dan 7B.

Sudahkah Anda mencobanya? Jika sudah, beri tahu kami di komentar apa pendapat Anda.

Nisa Arya adalah Ilmuwan Data, Penulis Teknis Lepas, dan Manajer Komunitas di KDnuggets. Dia sangat tertarik untuk memberikan nasihat atau tutorial karir Ilmu Data dan pengetahuan berbasis teori seputar Ilmu Data. Dia juga ingin menjelajahi berbagai cara Kecerdasan Buatan bermanfaat bagi umur panjang kehidupan manusia. Seorang pembelajar yang tajam, berusaha memperluas pengetahuan teknologi dan keterampilan menulisnya, sambil membantu membimbing orang lain.

Lebih Lanjut Tentang Topik Ini

CompTIA Mendukung Upaya Departemen Pertahanan untuk Memperkuat Pengetahuan dan Keterampilan Dunia Maya

Mengapa taksi tanpa pengemudi Waymo melaju di sisi jalan SF yang salah

Shiba Inu atau Dogecoin: Koin Meme mana yang harus dibeli untuk keuntungan 10X?

Pembaruan IQT Vancouver/Pacific Rim: Chief Security Officer Keyfactor, Chris Hickman adalah Pembicara 2024 – Inside Quantum Technology

DIG VR Terasa Seperti Simulator PowerWash Untuk Penggalian Daya

Petarung VR 3v3 'Brazen Blaze' Segera Mendapat Uji Beta Terbuka Baru di Quest & Steam

Kembali dari Ambang Batas: UnitedHealth Menawarkan Pembaruan Pasca-Serangan yang Menyedihkan

John Carmack Tidak Menganggap Meta Horizon OS Adalah Ide Yang Bagus

Kebingungan Tampaknya Mengumpulkan $250M-Plus Dengan Penilaian $2.5 Miliar Atau Lebih — Laporkan

Pasqal dan Welinq Bermitra untuk Mengembangkan Interkoneksi Kuantum – Analisis Berita Komputasi Berkinerja Tinggi | di dalamHPC